VLM들은 연역적 추론을 얼마나 잘 수행할 수 있을까?

안녕하세요, 여름감기에 걸린 블로그 주인장입니다.

오늘은 VLM(Vision and Language Model)과 관련된 논문을 소개해드리려고 합니다.

해당 논문의 제목은 How Far Are We from Intelligent Visual Deductive Reasoning? 으로 APPLE 사에서 2024년 3월에 공개한 논문이며, ICLR 2024 AGI Workshop에서 발표한 내용입니다.

일단 Background 지식을 짚고 넘어갈게요.

멀티모달(Multi-modal)이 뭘까요?

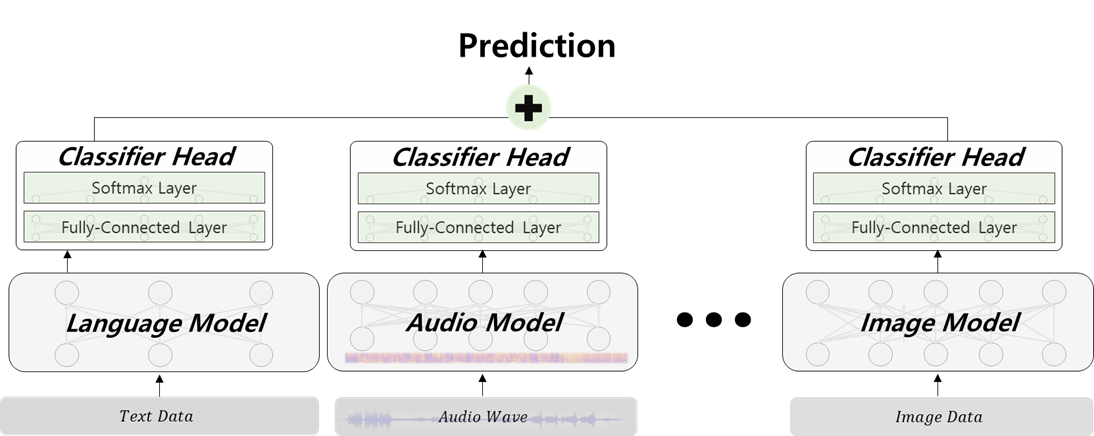

첨부사진이 너무 짜치긴(?)한데, 멀티모달이란 여러 가지 감각이나 데이터를 동시에 다룬다는 뜻입니다.

예를 들어, 사람은 눈으로 본 것과 귀로 들은 것을 동시에 이해할 수 있죠. 컴퓨터에게 이런 능력을 주는 것이 바로 멀티모달 기술입니다.

자연어만 처리하는 모델이다, 이미지만 처리하는 모델이다, 음성만 처리하는 모델이다 -> 이런경우 유니모달(Uni-modal)모델이라고 합니다.

이런 다른 모달리티를 결합해서 학습하고 추론하고 생성하는 모델을 멀티모달(Multi-modal)모델이라고 합니다.

Vision Language Model = Multimodal Model 이라고 정의를 하고 글을 이어 써내려가겠습니다.

과거에는 멀티모달 task를 해결하기 위해서 각각의 모델을 통해 각각의 모달리티를 처리하고, 최종 출력으로 나온 벡터값들을 결합하여 해결하는 방식이였습니다.

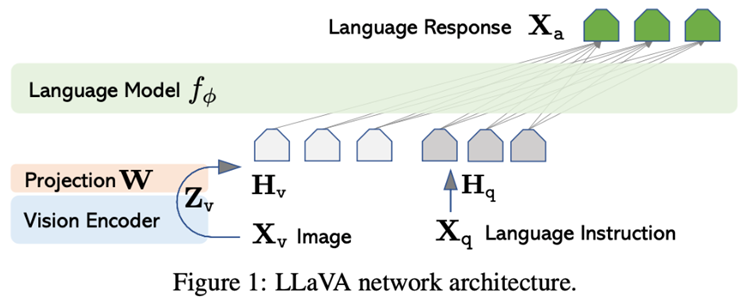

하지만 이제는 pre-training 방안 및 model의 parameter를 대폭 키우는 방안이 모델의 성능을 향상시키는데 효과가 있음이 검증되었죠? 그렇기 떄문에 대형멀티모달모델(Large Multimodal Model, LMM)을 만들기 시작했고, 출력부분에서 합치는것이 아닌 입력부분에서 모달리티를 합쳐서 학습하는 방안이 많아졌습니다.

이런 방식으로 각각의 모달리티를 같은 차원으로 매핑하여 이질성을 최소화시킨 뒤 모델에게 입력시키는 방식이 많아졌습니다.

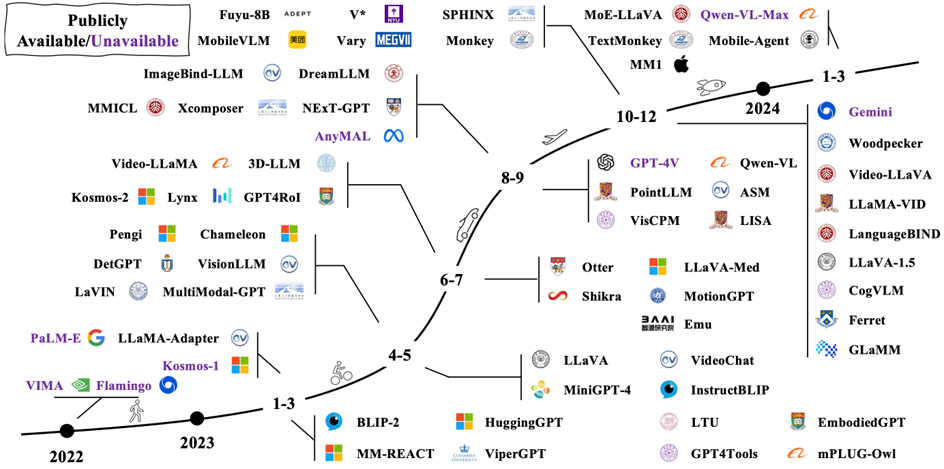

그리고 다음은 2024년 3월까지의 멀티모달 모델 흐름도입니다.

chatGPT 서비스로 보시면 아시겠지만, gpt-4o만 봐도 multi modal task를 해결하는 능력이 대폭 향상되었습니다.

- Captioning(이미지 보여주면 해당 이미지 설명해줌), Multimodal world knowledge and commonsense(다양한 데이터를 활용한 상식 이해), VQA(이미지넣고 질문하면 대답해줌), OCR(이미지 속 텍스트 정확히 추출), 차트 표 이해 등등 이전과 달리 엄청나게 능력이 향상되었습니다.

VLMs아 이거 풀 수 있니?

APPLE 직원들은 이제 의문을 던집니다.

VLMs은 점점 발전 중이긴 한데... 아직 어려운 문제들이 많이 존재한다고 얘기합니다.

그 중 하나가 “복잡한 다단계의 관계형 및 연역적 추론 능력“이라고 합니다.

본 논문에서는 SOTA VLMs을 통해 이전까지 고려되지 않던 맹점을 언급하고, 앞으로의 발전 방향을 제시합니다.

<Key Point>

1. VLM의 시각적 연역 능력 성능 분석을 위한 벤치마크 및 프레임워크 구축

2. 3개의 데이터셋 (Mensa IQ Test, IQ, Intelligence Test , RAVEN)에서 VLM 평가

3. 현재 효과적인 LLM 전략(few-shot learining, self-consistency) 이 VLM에도 효과적인지

4. 모델 입장에서 Vision 정보와 Language정보 중 어떤게 더 효과적으로 고려되는지 비교

5. 현재까지의 VLM 한계 설명, 앞으로의 방향 제안

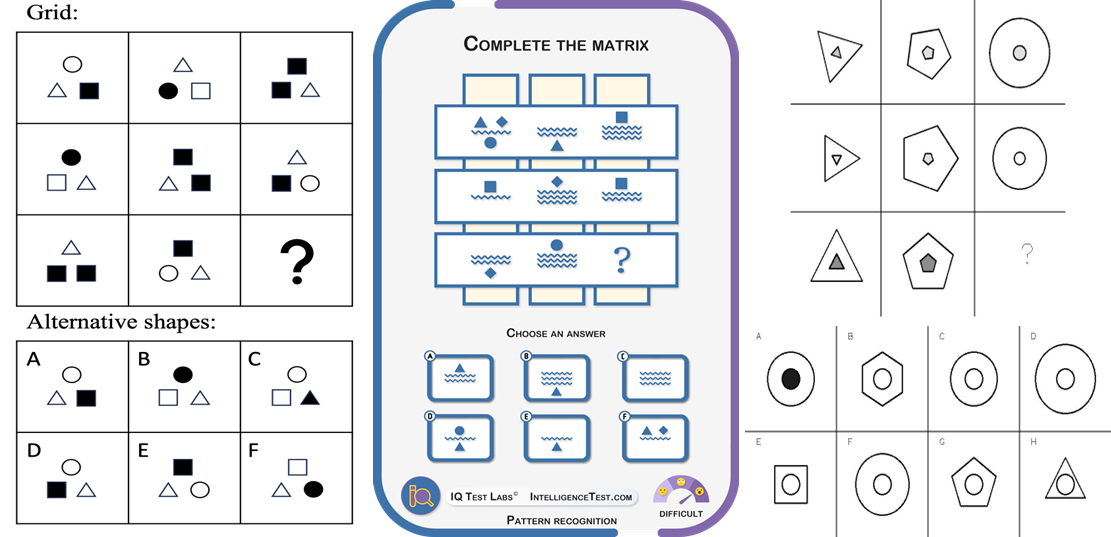

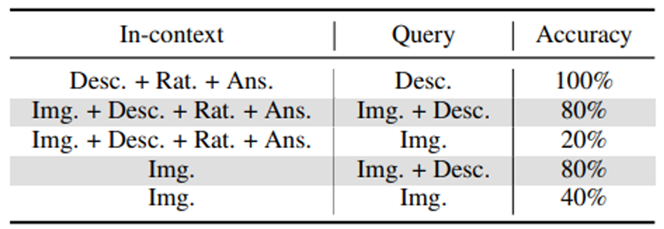

Datasets

실험에 사용된 데이터셋은 크게 세가지입니다.

1. Mensa Test : 35개 중 1개만 One-shot으로 사용하여 34개 사용

2. IntelligenceTest (IT) : 언어, 패턴인식, 수학 등등 있음. RPM문제로 66개 사용

3. RAVEN : 14000개 있고, 7가지 유형이 있는데 유형 당 20개씩 140개 사용

*RPM이란?

-----------------------------------------------------------------

RPM이란?

RPM은 일반적으로 일반적인 인간 지능과 추상적 추론을 측정하는 데 사용되는 비언어적 테스트 -wiki

-----------------------------------------------------------------

Prompts & Models

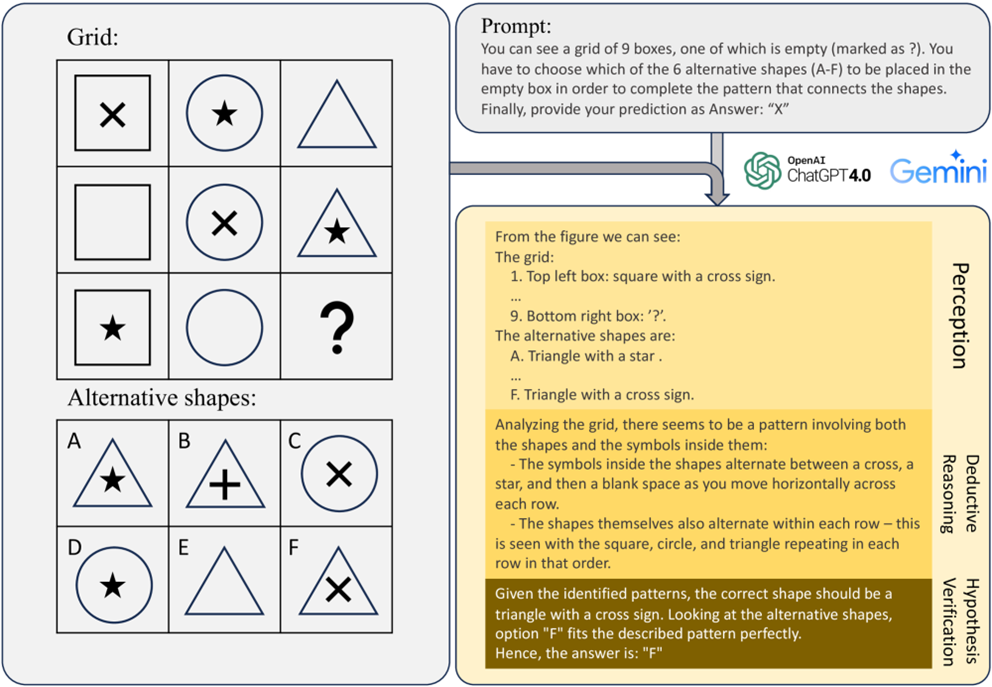

Mensa Test 데이터셋에서 zero-shot할 떄의 prompt만 예시로 가져왔습니다.

You can see a grid of 9 boxed, one of which is empty (marked as ?). You have to choose which of the 6 alternative shapes (A-F) should be placed in the empty box in order to complete the pattern that connects the shapes. Finally, provide your prediction as Answer:“X”. {query image}

이런식으로 실험에 사용된 모든 프롬프트는 논문 부록에 적혀있으니 궁금하다면 확인하시면 될 것 같습니다.

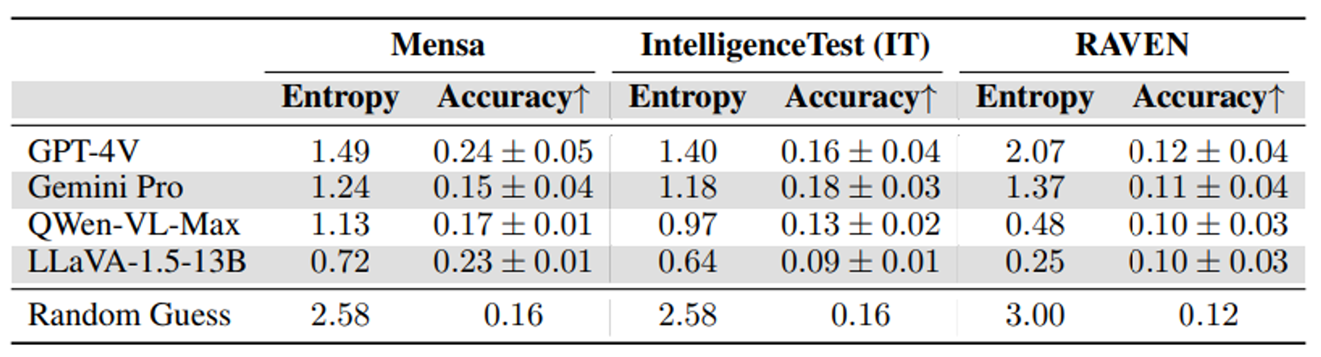

실험에 사용된 모델은 다음과 같습니다.

- gpt-4-vision-preview

- Gemini-pro

- Qwen-VL-Max

- LLaVa-1.5-13B

VLMs은 이런 문제도 잘 풀 수 있나?

자, 이제 실험의 결과를 볼까요?

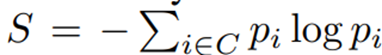

Entropy란?

-----------------------------------------------------------------

Entropy

모델이 예측할 때의 불확실성을 나타내는 지표

높을수록 불확실(물어볼때마다 답바뀜), 낮을수록 결정론적(확실)

이를 파이썬 코드로 쓰면 다음과 같음

probabilities = [0.90, 0.05, 0.02, 0.01, 0.01, 0.01]

entropy = -sum(p * np.log(p) for p in probabilities)-----------------------------------------------------------------

이 실험의 결과를 보면 다음과 같습니다.

1. 현재 모델은 랜덤 수준에 머무르고 있음

2. 틀린 답을 확신을 가지고 있음 (훈련과정에서 이러한 불확실성을 조정하지 않은 것이 문제라고 판단하고 있음)

3. 모델이 시각적 패턴을 인식하고 설명하는 능력에 한계가 있는 것으로 보임

LLM 표준 전략이 시각적 연역적 추론 과제에서도 효과적일까?

이 실험의 결과를 보면 다음과 같습니다.

1. 성능이 살짝 오르긴 하나 효과 없음

2. 오히려 오답을 더욱 확실하게 말함

3. LLM 표준 전략과는 다른 새로운 접근 방법 및 전략이 필요함

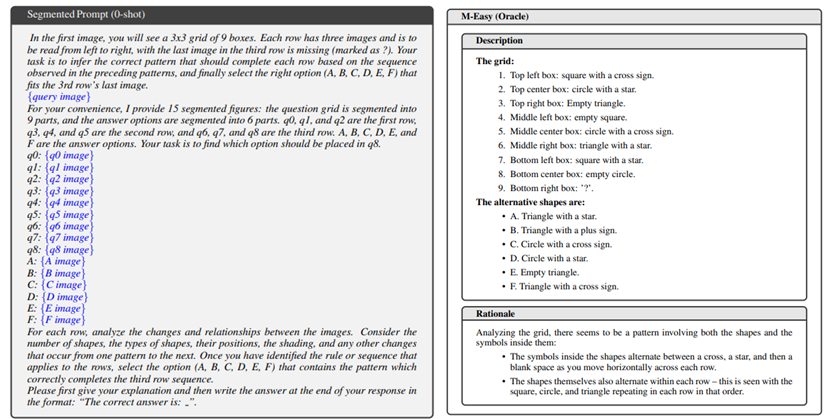

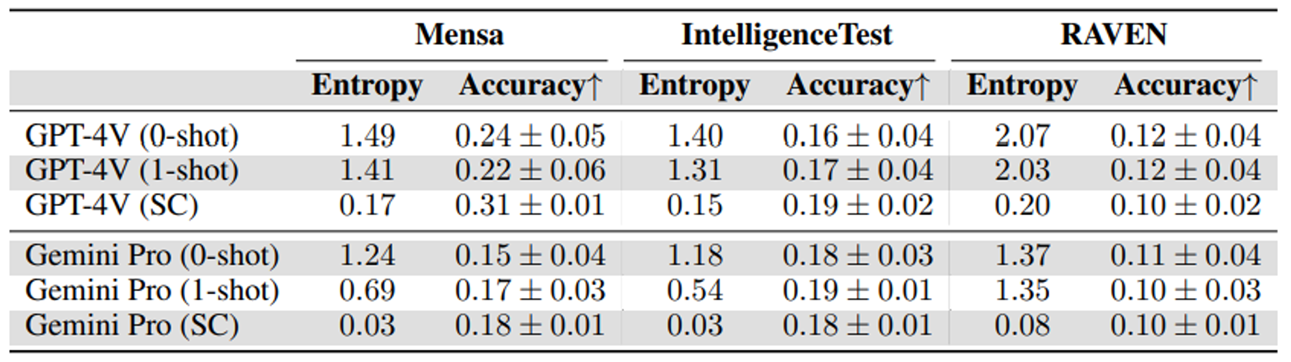

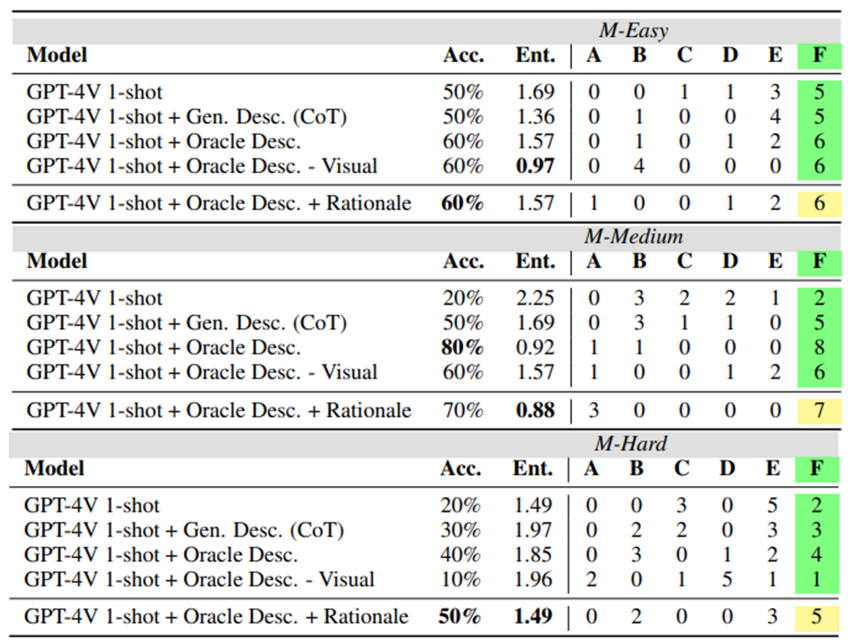

어떤 모달리티가 가장 도움이 될까?

GPT-4V를 대상으로 실험을 진행했습니다.

설명(Description), 논리적 이유(Rationale), 답변(Answer)을 포함한 예제를 제공한 후, 모델의 성능을 평가하였습니다.

이 실험의 결과를 보면 다음과 같습니다.

1. 설명만 주었을 때 가장 성능 높음

2. 이미지 사용하면 오히려 성능 떨어짐

3. 이질성 최소화하는 연구가 필요함

난이도를 조정해줄게. 풀어봐!

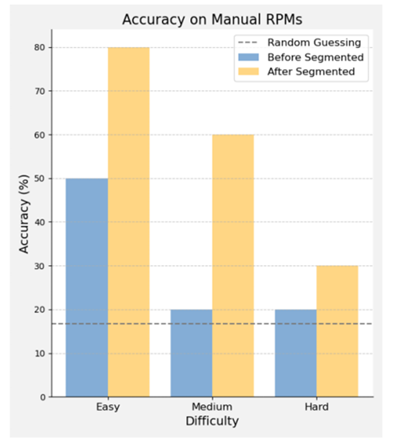

저자들은 데이터셋을 사용해서 난이도별로 나누어 새로 구축하였습니다. (Easy, Medium, Hard)

여기서 총 두가지 오류를 발견했습니다.

1. 복합 오류(Compounding Error) :모델이 이전 패턴 설명에서 발생한 오류를 반복하면서 점점 오류가 증폭되는 현상 발견

2. 혼동 오류(Confounding Error): 모델이 유사한 패턴들 사이에서 혼동이 일어나 이 패턴들을 혼합하여 이상한(새로운) 패턴을 설명하는 경우 발견

이 실험의 결과를 보면 다음과 같습니다

1. 일반적인 이미지 및 쉬운 추론 작업은 잘 하나, 추상적 패턴 설명 등에는 많은 오류 발생

2. 각 패턴을 개별적으로 분리하여 자세하게 설명한 뒤 모델에게 입력하면 정확도 향상 및 혼동 오류 감소

3. 보다 정교한 데이터셋 필요

난이도 별로 분석을 해보자

이 실험의 결과를 보면 다음과 같습니다

1. 간단하거나 중간 난이도 task에서는 이미지 없어도 성능이 나오지만 어려운 task는 이미지가 필요함

2. 모델의 성능 높이려면 정확하고 명확한 텍스트 설명과 논리적인 이유 제공해야함

잠깐 지금까지의 결과 중 헷갈릴만한 내용을 요약 및 정리하자면,

1. 모델의 입장에서 문제를 해결할 때 도움이 되는건 텍스트 > 이미지 이다.

2. 쉬운 task(일상적인 사진 설명 및 질문, 간단한 추론)에서는 텍스트만 있어도 성능 나오고, 오히려 이미지 넣으면 성능 낮아진다.

3. 하지만!!! 위와 같이 모델입장에서 어려운 task에서는 이미지가 꼭 필요하다. 텍스트 설명만으로 부족하다.

이정도로 요약할 수 있을 것 같아요.

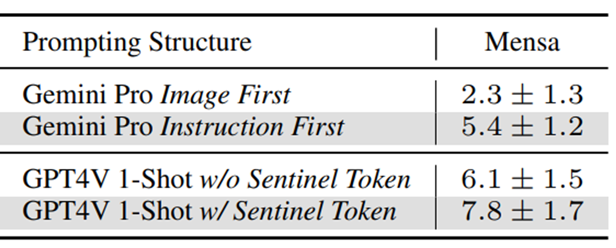

추가실험!

이미지를 먼저 넣는 것 보다 텍스트를 먼저 넣는 것이 성능 향상에 도움이 된다고 합니다.

또한, 주석처럼 Sentinel Token을 사용하는 것도 성능 향상에 도움이 된다고 합니다.

결론!!

최신 모델들은 텍스트 기반의 추론에서는 뛰어난 성과를 보이지만 시각적 연역 추론은 아직 어려워하고 있습니다.

즉, 현재 VLM들은 복잡하고 혼란스러운 추상 패턴을 이해하고 인식하는 능력이 부족하다고 합니다.

따라서 모델의 성능을 향상시키기 위해 본 논문에서 말하는 내용을 고려하는 것이 VLM의 시각적 정보처리 능력을 발전시키는데 도움을 줄 것 같습니다.

또한, 자연어에서의 유명한 몇가지 추론 전략(In-context learing, self-consistency 등등)은 연역적 시각 추론(or 모델 입장에서 어려운 task)에서는 효과적이지 않기 때문에 다른 새로운 전략이 필요하다고 말하고 있습니다.

애플이 계속 멀티모달 논문을 내고 공개를 하는 데, 애플 뿐만 아니라 많은 회사에서 멀티모달 논문을 내는 것이 LLM에서 LMM으로 트렌드가 더욱 빠르게 옮겨가고 있는 것 같다고 생각합니다.

멀티모달 파이팅! ㅎㅎ